目次を開く

カテゴリ

はじめに

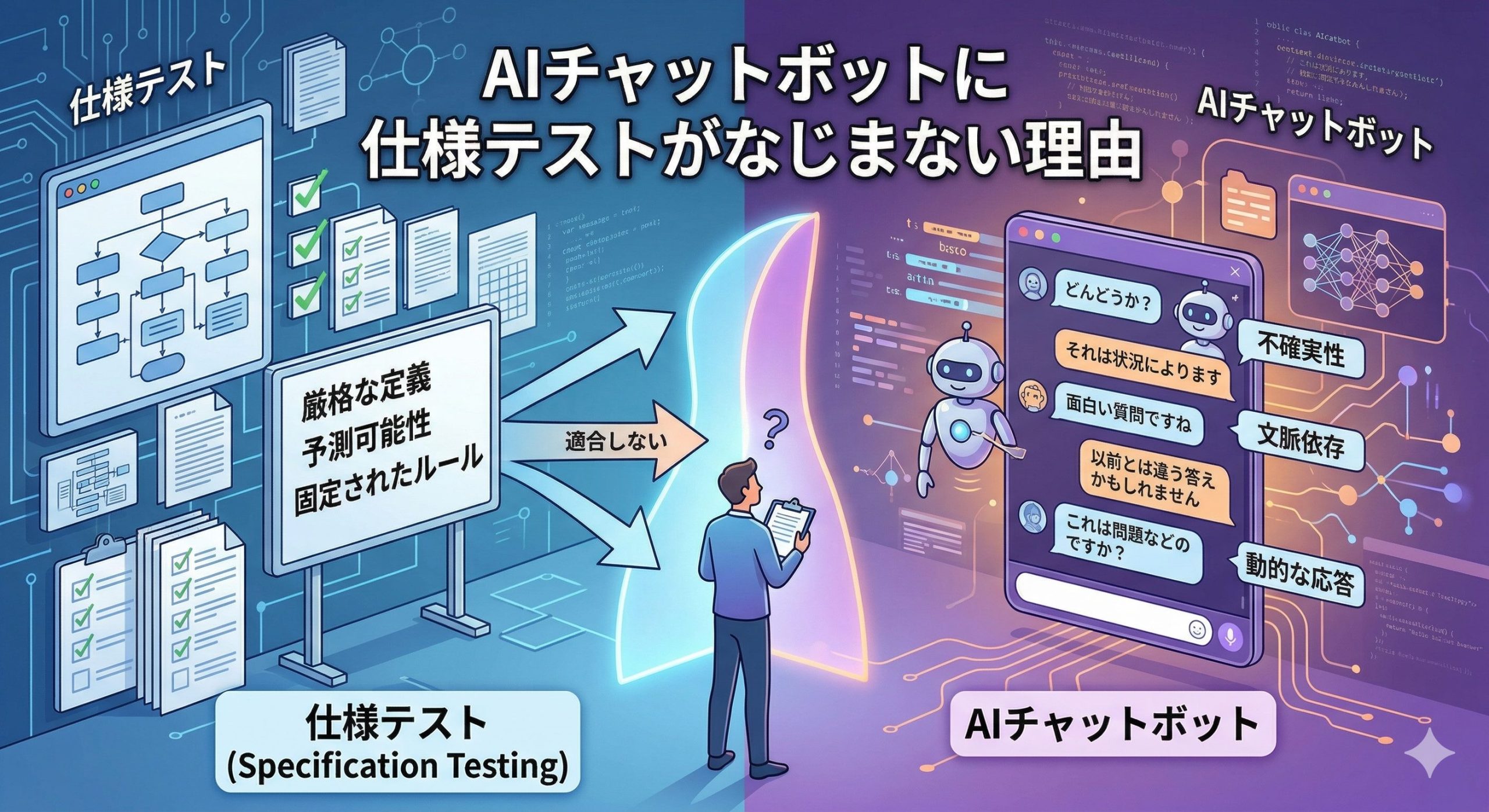

AIチャットボットをテストしようとすると、最初に多くの技術者が持ち込むのが従来システムの仕様テストである。入力に対して期待される出力を決め、その一致を見るやり方である。

この方法は、入力と出力の関係が固定されているシステムでは有効である。だが、AIチャットボットではこの考え方だけでは足りない。なぜなら、AIチャットボットは正しい文面を返す仕組みというより、会話を通じて利用者を目的へ近づける仕組みだからである。

本記事では、AIチャットボットに仕様テストがなじみにくい理由を整理し、実務では何を見て品質を判断すべきかをまとめる。

先に結論

- AIチャットボットは、同じ入力でも返し方が1つに固定されない

- そのため、期待文面との一致だけでは品質を測れない

- 見るべきなのは、会話が前進したか、利用者が目的へ近づけたかである

- 仕様テストは一部では使えるが、中心には置きにくい

- 実務では会話シナリオと到達点で評価するほうが再現性が高い

なぜ従来の仕様テストを当てはめたくなるのか

技術者がAIチャットボットでも仕様テストをやりたくなるのは自然である。従来のシステム開発では、仕様があり、期待結果があり、それに対してテストケースを作ることで品質を担保してきたからである。

たとえば、次のような考え方である。

- この入力ならこの出力になるはず

- この条件ならこの分岐に入るはず

- この異常値ならこのエラーが返るはず

この形は、入力と出力の対応関係が明確なシステムでは非常に強い。テストケースを増やすほど抜け漏れを減らしやすいからである。

ただし、AIチャットボットはこの点が大きく異なる。

AIチャットボットは”正解文面”が1つではない

AIチャットボットでは、利用者の発話に対する返答が1つに定まりにくい。理由は、会話の目的が単なる回答ではなく、整理、問い返し、補足、次の行動提示まで含むからである。

たとえば、利用者が次のように入力したとする。

- 転職したいけど何から始めればいいかわからない

この入力に対して、妥当な返し方は1つではない。

- まず何に悩んでいるかを問い返す

- 転職理由、希望条件、時期の3点に分けて整理する

- 最初にやることを2〜3個に絞って提示する

どれも間違いとは言い切れない。重要なのは、利用者の状況に応じて会話が前に進むことだからである。これに対して「期待文面と一致したか」で判定すると、むしろ良い返答を不正解にしてしまうことがある。

同じ入力でも、良い返答は変わる

AIチャットボットでは、同じ入力文字列でも、前後の文脈や会話履歴によって良い返答が変わる。

たとえば、「ログインできない」という発話でも、次のように状況は異なる。

- 初回問い合わせで原因が何もわからない

- すでにパスワード再設定を試している

- 複数人に同じ事象が起きている

- エラーメッセージが表示されている

この場合、適切な返答は同じではない。最初に確認すべきことも、次に案内すべきことも変わる。入力文字列単体では期待値を固定しにくいのはそのためである。

仕様テストは、入力から出力が決まりやすい世界では強い。だが、AIチャットボットは入力だけでなく、文脈、目的、会話の進み具合まで含めて判断する。そのため、単発の入出力一致だけでは品質を捉えきれない。

AIチャットボットの役割は”答えること”だけではない

仕様テストがなじみにくい理由の1つは、AIチャットボットの役割が従来の回答システムより広いことにある。

AIチャットボットは、次のような役割を持ちやすい。

- 利用者の意図を整理する

- 不足情報を問い返す

- 複数論点を分ける

- 次の行動を提示する

- 必要なら人へ戻す

1回の回答で完成した答えを返すより、会話全体で利用者をゴールへ近づけることに価値がある。1つの返答単位に評価が寄りすぎると、会話全体の良し悪しを見落としやすい。

仕様テスト中心で進めると起きやすい問題

AIチャットボットを仕様テスト中心で評価すると、実務では次のような問題が起きやすい。

- 文面の一致ばかり見て、会話の価値を見ない

- 想定外の良い返しを不正解にする

- 問い返しを減らして定型回答へ寄せてしまう

- 会話の柔軟さを自ら削る

- テストは通るのに使われないAIになる

特に多いのは、「テストケースでは正しいが、実運用では使いにくい」状態である。これは、AIチャットボットを会話システムとしてではなく、固定回答システムとして評価していることが原因になりやすい。

では、何をテストすべきか

AIチャットボットで本当に見るべきなのは、期待文面との一致ではなく、会話として妥当かどうかである。実務では、次の観点が重要になる。

- 利用者の意図を捉えられたか

- 必要な問い返しができたか

- 論点を整理できたか

- 誤った方向へ誘導していないか

- 利用者が次の行動へ進める状態になったか

この見方に変えると、1回の返答だけで正誤を決めるのではなく、会話全体が目的へ向かっていたかで品質を見られるようになる。

仕様テストが完全に不要というわけではない

ここで注意したいのは、仕様テストを全否定しているわけではないという点である。AIチャットボットでも、仕様テストが向く部分はある。

仕様テストが向く領域

- 禁止回答の制御

- 特定条件での定型案内

- 外部システム連携のデータ形式

- 人へ戻す条件の判定

仕様テストだけでは足りない領域

- 曖昧な相談の整理

- 問い返しの妥当性

- 複数論点の分解

- 会話の流れとしての自然さ

ルールや境界は仕様テストで見られるが、会話品質そのものは別の見方が必要になる。この2つを分けて考えることが重要である。

AIと自動化の境界

このテーマでは、どこまでをAIの会話品質として見て、どこからをルールや自動化で担保するかを明確にしたほうがよい。

AIに任せる範囲

- 利用者の意図の解釈

- 問い返しの組み立て

- 論点整理

- 会話の進行

ルール・自動化で処理する範囲

- 禁止事項の制御

- 定型フローへの接続

- エスカレーション条件の判定

- 構造化データへの変換

人が判断する範囲

- 高リスクな最終判断

- 例外対応の承認

- 会話品質のレビュー

- 改善方針の決定

この切り分けがあると、仕様テストをどこに使い、どこで別の評価が必要かが見えやすくなる。

期待値の明示

できること

- 利用者の曖昧な相談を整理する

- 会話の中で必要情報を補う

- 次の行動候補を提示する

できないこと

- すべての入力に対して唯一の正解文面を返すこと

- 単発の入出力一致だけで会話品質を保証すること

- 高リスク領域の最終判断を自動で確定すること

苦手な条件

- 会話のゴールが未定義なまま評価する場合

- 文面一致だけで良し悪しを判断する場合

- 想定外の会話を失敗としてしか見ない場合

運用で事故りやすいポイント

- 誤判定パターン:期待文面と違うだけで不合格にする

- データ品質依存で崩れる例:評価用プロンプトやテストケースが実運用の会話を再現していない

- 監視・ログ:会話ごとの到達点、問い返し回数、エスカレーション率は最低限見たい

- レビュー/承認フロー:高リスク会話と失敗会話は人がサンプルレビューする

- 例外時の対応:回答不能、危険領域、長期ループ時は人へ戻す導線を持つ

よくある落とし穴

- 症状:テストケースは通るのに、現場で使われない

- 原因:文面一致ばかり見て、会話の価値を見ていない

- 回避策:到達点と会話シナリオで評価する

- 症状:AIの返答がどんどん定型文になる

- 原因:仕様テストに合わせて自由度を削っている

- 回避策:ルールで縛る領域と会話で持たせる領域を分ける

- 症状:想定外の良い返答が不正解扱いされる

- 原因:期待文面を1つに固定している

- 回避策:返答文そのものではなく、会話目的への到達で判定する

判断に迷ったときの指針

- 仕様テストを使う条件:禁止回答、連携形式、エスカレーション条件など、ぶれると事故になる部分

- 会話シナリオで見る条件:意図整理、問い返し、論点分解、次の一手の提示など

- 最終的な推奨:仕様テストは境界管理に使い、会話品質は到達点ベースで別に評価する

まとめ

AIチャットボットに仕様テストがなじまないのは、入力と出力の関係が固定されていないからである。AIチャットボットの価値は、正しい文面を返すことだけでなく、会話を通じて利用者を目的へ近づけることにある。

品質を見るときは、文面一致だけでは不十分である。実務では、仕様テストを使う領域と、会話シナリオで見る領域を分けたほうがよい。ルールや境界は仕様で管理し、会話の良し悪しは到達点と前進度で評価する。この切り分けができると、AIチャットボットを従来システムの延長ではなく、会話システムとして正しく扱いやすくなる。

関連キーワード

- メインキーワード:AIチャットボット 仕様テスト

- 同義語:AIチャットボット テスト設計、AIチャットボット 品質評価

- 関連領域:AIチャットボット 会話シナリオ、AIチャットボット ゴール設計、AIチャットボット QA